POSTECH, 딥러닝 기반 다중 모달 융합 네트워크 개발

양성환자 7명 5번 중 3번, 악성 환자 6명 5번 전부 예측

![POSTECH 연구진이 기존 대비 정확히 유방암을 분할·분류할 수 있는 초음파 기술을 개발했다. (왼쪽부터)김철홍 IT융합공학과·전자전기공학과·기계공학과 교수, 전자전기공학과 미스라 삼파(Misra Sampa)·윤치호씨. [사진=POSTECH 제공]](https://cdn.hellodd.com/news/photo/202302/99715_317406_09.jpg)

POSTECH(총장 김무환)은 김철홍 IT융합공학과·전자전기공학과·기계공학과 교수팀이 B-모드(B-mode)와 초음파 변형 탄성 영상을 함께 이용해 기존보다 정확히 유방암을 분할·분류하는 딥러닝 기반 다중 모달 융합 네트워크를 개발했다고 27일 밝혔다. 이번 연구는 전자전기공학과 미스라 삼파(Misra Sampa)·윤치호씨가 참여했다.

초음파 검사는 유방 병변 평가를 위한 주요 의료 영상 양식 중 하나다. 컴퓨터 보조 진단(CAD) 시스템은 악성 병변(병으로 인해 나타나는 생체의 변화)과 양성을 구별하기 위해 병변의 특징을 자동으로 세분화하고 식별함으로써 방사선 전문의에게 큰 도움을 준다.

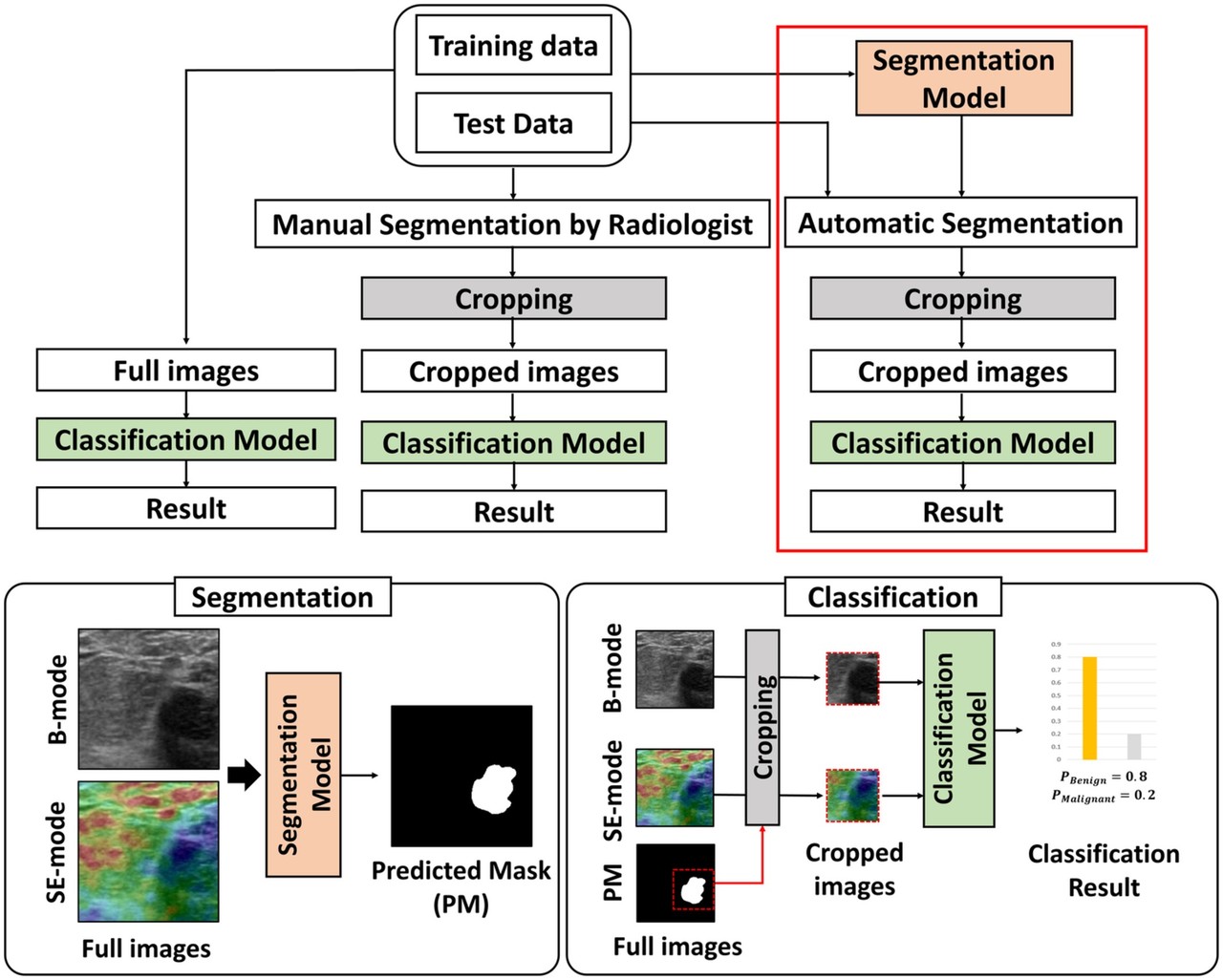

먼저, 병변의 분할을 위해 가중 스킵 커넥션 방법을 사용해 서로 다른 영상 양식에 최적의 가중치를 적용하는 '가중 멀티모달 U-Net 모델'을 개발했다. 이어 양성·악성 병변 분류를 위해 잘린 B-모드와 SE-모드 초음파(이하 US) 병변 이미지에 대한 '다중 모드 융합 프레임워크(이하 MFF)'를 제시했다.

MFF는 통합 피처 네트워크와 의사 결정 네트워크로 구성된다. 제안한 MFF 방법은 다른 융합 방법과 달리 B-모드와 SE-모드 US 이미지를 사용해 훈련된 '컨볼루션 신경망(이하 CNN)'에서 보완 정보를 동시에 학습할 수 있다. CNN의 기능은 멀티모달(EmbraceNet) 모델을 사용해 조립되고, DN은 이런 기능을 사용해 이미지를 분류한다.

실제 임상 데이터 실험 결과, 양성 환자 7명을 5번 중 3번 양성으로, 악성 환자 6명을 5번 중 5번 전부 악성으로 예측했다. 이는 지금까지의 단일·다중 초음파 방법을 넘어선 수치다.

김철홍 교수는 "입력 영상의 중요도를 판단하고 적절한 가중치를 자동으로 할당해 더 정확한 병변 분할을 가능케 했다"며, "딥러닝 모델과 앙상블 모델을 동시에 학습시켜 기존의 단일 모드나 다른 다중 모드 대비 훨씬 뛰어난 분류 성능을 보였다"고 말했다.

한편 이번 연구는 과학기술정보통신부, 교육부, ETRI(한국전자통신연구원)의 지원으로 수행됐다. 연구 성과는 바이오메디컬 분야의 국제 학술지 'Bioengineering & Translational Medicine'에 게재됐다.

[참고자료]

Deep Learning-based Multimodal Fusion Network for Segmentation and Classification of Breast Cancers using B-mode and Elastography Ultrasound Images : https://doi.org/10.1002/btm2.10480

댓글 정렬